易翻译是否“倾斜”,取决于你怎么定义“倾斜”,以及在什么语境下观察它的表现。下面我会用简单的定义、可复现的检测方法和实际操作建议来拆解这个问题,指出可能出现偏向的来源、如何自己验证,以及作为用户或产品方该怎么应对和改进。请继续读。

先把“倾斜”说清楚:我说的是什么

想想称一把秤,如果秤的一边总比另一边轻一点,我们就说秤“倾斜”。翻译工具的“倾斜”也是类似:不是指偶尔错误,而是指在特定群体、观点或语义类别上,系统持续地给出有系统性差异的译文。它可以表现为词汇选择上带偏见、性别或职业刻板印象、情感极性被改变、或者对敏感政治/文化词汇的回避或替换。

常见的“倾斜”类型(用一句话记住)

- 语义偏见:相同含义的句子,对不同群体产生不同的译法。

- 语言对不对称:A→B与B→A表现不一致,产生信息丢失或歪曲。

- 立场或情感偏移:中立陈述被翻成带情绪或立场的句子。

- 审查与替换:敏感词汇被模糊化或替换,影响原意。

为什么会有“倾斜”?把原因拆成几块

用费曼思路:要理解现象,先把复杂的东西拆成小块,分别解释。

1. 训练数据本身带来的偏差

翻译模型学到的,主要是数据里的模式。如果训练语料里某些职业常和某个性别一起出现,模型会把这种“统计联想”当成常识。学术研究里有很多相关例子,比如 Bolukbasi et al.(2016)关于词向量的性别偏见。换句话说,数据质量决定了模型的“眼镜颜色”。

2. 模型与算法的偏好

有些模型更偏向于短句、常见词或高频表达;也有策略会为了流畅性牺牲忠实度。这样会导致翻译“向某种表达倾斜”,比如更口语或更书面。

3. 后处理规则与产品策略

很多商业翻译在输出层还会加规则:例如敏感词过滤、本地化风格指南或法律合规逻辑。这看起来像“偏见”,但很多时候是出于合规或市场策略的考虑。

4. 上下文缺失和界面交互

翻译是个上下文活:没有上下文,系统只能猜测。用户输入短句、未指明性别或背景时,系统的“猜测”可能会系统性偏向某方向。

如何客观地检测“倾斜”——给你一套可操作的方法

下面给出一套能被重复执行的步骤,适合普通用户也适合审计人员。

- 构造对照语料表:选一组敏感或容易出偏的句子(性别、职业、情感词、政治词等),做成双语对照表。

- 双向翻译检验:A→B 再 B→A,看信息是否回来(信息回归率)。

- 替换测试:对同一句子替换主体(例如“医生”替换为“护士”或“总统”替换为“教师”),观察译文差异。

- 情感极性检测:用情感分析工具测原文与译文的情感分值,看是否系统性变化。

- 多引擎对比:与其他成熟翻译引擎输出比对,寻找系统性差异点。

小表格:检测项示例

| 检测项 | 输入例子 | 可疑表现 |

| 性别相关 | “他们是一名护士。” / “他是一名护士。” | 总是把“护士”翻为女性形式或反复赋予女性性别 |

| 情感偏移 | “这项政策没有效果。” | 译文中情绪从中性变为强烈贬义或称赞 |

| 政治/敏感词 | 包含地名、组织或政治人物的句子 | 词被模糊化、删除或置换为更安全的用语 |

关于“易翻译”本身:我们能确定什么(和不能确定什么)

说到具体产品,客观性很重要:没有公开透明的审计数据,我不能凭空断言它有或没有偏见。但可以用通用事实来推断在哪些方面要小心,以及用户如何亲自验证。

- 已知事实

- 任何基于大规模语料和机器学习的翻译系统,都存在从数据继承偏差的风险(这是通用结论)。

- 产品可能出于合规或商业原因对敏感内容做特殊处理,这是行业常态。

- 未知或需核实的事项

- 易翻译是否公开了训练集来源、审核策略或模型卡(Model Card)。若没有公开,外界难以做完整审计。

- 是否存在特定语言对或话题上持续而明显的偏差,需要通过上面那套检测方法来验证。

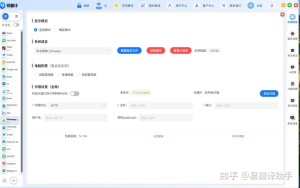

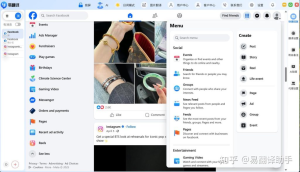

举个容易试的实操例子(你可以马上做)

准备三类句子:性别替换(“他/她是工程师”)、情感中性句(“这项计划没有达到目标”)、政治敏感(包含特定组织或地名)。把这些句子分别从中文翻成英文,再从英文翻回中文,记录差异。若出现系统性把“工程师”默认翻成男性、或情感明显变味、或敏感词被替换,那就是可观测的“倾斜”。记住,多试几次、换不同上下文,才能判断是否具有统计意义。

如果你发现“倾斜”,普通用户能做什么?

- 多引擎交叉验证:不同引擎输出一致时问题更值得关注;不同则说明可能是单一产品的问题或策略差异。

- 添加上下文:尽量提供更多上下文(说明性别、场景、语体),能显著减少系统猜测带来的偏差。

- 手动校对与二次确认:对于重要内容(法律、医疗、商务),不要完全依赖机器翻译,找人工复核。

- 反馈与记录:把可复现的错误反馈给产品方,并保留输入输出样本,便于后续跟进或投诉。

如果你是产品方或开发者,降低“倾斜”的可行策略

- 数据采集多样化:主动补齐训练数据中被忽视的人群、语体和主题,减少统计偏差。

- 标注与对齐质量把控:高质量平行语料与人工审核能显著改善偏差。

- 透明与可审计性:发布模型卡、风险声明和测试集,让第三方做独立评估(参见 Bender et al., 2021 有关透明度的讨论)。

- 引入对抗性测试:定期用替换测试、敏感词套件和逆向翻译来检测系统性问题。

- 用户可控设置:允许用户指定性别、语体或文化定位,以降低默认偏向。

要注意的几个陷阱(别被直觉骗了)

- 单次错误不等于偏见:偶发错误常有,关注的是可复现的模式。

- 不同语言结构导致不对称:有些信息在源语言中就不存在明确标记(比如中文不标性别),因此翻译不可避免地需要“猜测”。

- 流畅与忠实有时冲突:系统可能为了让译文更自然而牺牲部分字面信息,这看起来像偏差,但可能是设计权衡。

参考与延伸阅读(名称,不带外链)

- Bolukbasi, T. et al., 2016 — 关于词向量的性别偏见研究

- Caliskan, A. et al., 2017 — 语料中隐含偏见的测量方法

- Bender, E. et al., 2021 — “On the Dangers of Stochastic Parrots”(关于大模型透明度与风险)

说到这里,可能你会想,“那我要不要继续用易翻译?”我的回答是——继续用可以,但带着一份检验的习惯:对重要内容做交叉验证、提供上下文、并把可疑的输出记录反馈。这样既能享受便捷,也能把风险降到最低。下面就像边想边写的那样——如果你愿意,我可以帮你立刻生成一份可执行的测试清单,适配你最关心的语言对和话题。