在常见的交流场景里,哪个翻译更准取决于语言对、文本类型与使用需求:短句、口语、行业术语、长文语境、OCR或实时语音,各有不同表现。易翻译在本地化、语音和拍照体验上做了优化,谷歌翻译凭借更大语料和跨语种泛化通常更稳。要判断谁更准,最好用你常用的真实文本和对比测试来决定。下面逐项说明,并给实用建议。谢谢

先把问题拆开:我们说的“更准”到底指什么?

按费曼的思路,先把概念讲清楚。翻译准确性不是单一维度,它包含至少几个方面:

- 语义等价:译文是否保留了原文的核心意思(没有漏译、曲解或添油加醋)。

- 流畅度:译文在目标语言是否自然、符合语言习惯(读起来不会像机器粘贴)。

- 术语与领域一致性:专业文本的术语是否翻译统一且合适(医学、法律、技术文档等)。

- 上下文连贯:多句或整篇文档的上下文是否被系统性保留(代词、指代、话题延续)。

- 多模态准确性:照片OCR、语音识别到文本再翻译的误差是否可接受。

两个产品的定位差异(公开信息与用户体验角度)

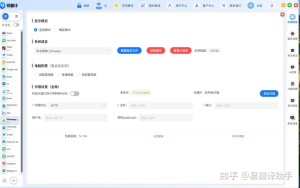

把易翻译和谷歌翻译放到同一张表里看更直观。这里遵循公开功能与常见用户感受来描述,尽量避免臆测内部实现细节。

| 比较项 | 易翻译 | 谷歌翻译 |

| 支持语言数 | 主打100+语言(以中文用户体验为中心,某些小语种支持有限) | 上百种语言,覆盖面非常广,尤其小语种不断扩展 |

| 模型与语料 | 侧重中文与热门语对的本地化语料与微调 | 基于大规模跨语种数据训练,泛化能力强(公开论文:GNMT等) |

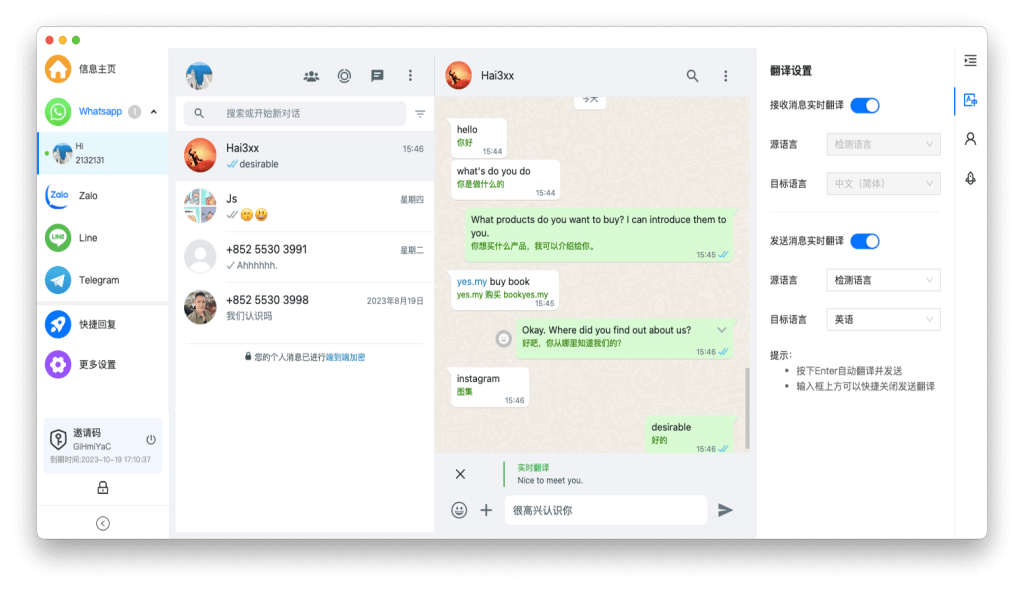

| 实时语音与对话 | 常见场景有针对性优化,如旅游口语、双语对话模式 | 强大的语音识别和端到端翻译流水线,实时性和鲁棒性优 |

| 拍照OCR | 通常针对中文场景优化识别与排版保持 | 全球化OCR引擎,识别多语种、复杂版面更稳 |

| 离线与隐私 | 可能提供离线包或本地化设置,隐私策略更贴近本土用户 | 提供部分离线模型,但云端服务是主力,隐私条款全球化 |

| 企业与API | 侧重本地化集成、企业定制与术语管理 | 成熟API、生态广泛(GCP、文档、自动化工具) |

为什么谷歌在“泛用准确度”上通常表现更好?(但不意味着对所有场景最优)

简单来说,谷歌翻译在许多公开比较中靠的是两个优势:

- 海量多源语料:网页、书籍、平行语料、用户反馈与翻译记忆,这些数据让模型学到更多常见表达和长尾现象的翻译。

- 大规模模型与不断迭代:投入资源训练更大的神经网络、使用混合架构(句子级、段落级上下文),并把线上用户的纠错/行为数据回流用于改进。

这些优势在常见语言对(中英、中法、英西等)和常规文本(短句、旅游会话、网页内容)上体现明显——你看到的正确率高、流畅度好、奇怪直译少。

为什么易翻译在某些场景里可能更“准”或者更好用?

“更准”有时候不是字面翻译对错,而是更符合你当下的需求。易翻译可能在这些方面胜出:

- 本地化优化:对中文使用者习惯、常见用语、地道表达做特别调校,尤其在中小语种到中文的翻译上表现亲和。

- 语音+OCR的一体化体验:把语音识别、方言处理、拍照取词与后处理做得更贴合手机端使用场景,减少多次操作的误差积累。

- 离线或隐私功能:如果提供本地模型或更明确的本地数据策略,对有隐私/合规需求的用户更合适,避免把敏感内容上传到海外服务器。

- 垂直领域定制:对特定行业(如旅游、餐饮、校园)做词库、模板优化,短句与对话场景的感知更好。

举例说明:短句和菜单翻译

想象你在国外点菜,原句是“Can I have the vegan option?” 两个系统都会给出正确、自然的译文。但如果原句是带口音或省略主语的口语(“Vegan option?”),易翻译那种专门针对旅行场景的对话模式可能直接给出“有素食吗?”而谷歌翻译虽准确,但在实时口语提示与连续对话的上下文保持可能需要更多输入才更贴合。

如何客观测试“哪个更准”:可执行的步骤

说白了,可靠的判断需要数据和测量。下面是一个可重复的方法:

- 选定语言对与场景:例如中英口语(旅行)、中英法律摘要、中文医学说明、OCR识别的菜单照片等。

- 准备测试集:每个场景至少200句/条真实样本,涵盖长短句、俚语、术语与歧义句。

- 自动指标评估:计算BLEU、chrF或使用COMET(更接近人类评估)的分数,做基线比较。

- 人工评审:至少找3位有语言能力的评审(双盲),对译文做5分制打分:准确度/流畅度/可用性,并标注错误类型(漏译、误译、增译、不自然)。

- 统计与分析:看总体得分,也要拆分错误类型和场景;注意置信区间与样本分布,别只看平均分。

- 真实世界试用:在手机上模拟实际使用,测试OCR在复杂背景下、嘈杂环境的语音识别、双语对话的延迟与中断恢复。

常见的误差类型与如何判断影响力

- 直译/机械翻译:字面正确但不地道。对外语学习者或读懂原意够用,但对读者体验是减分项。

- 术语错配:在专业场景(医疗、法律)会带来重大后果,这时术语库和可定制词典更重要。

- 漏译/增译:尤其在长句、多个从句时容易发生,需要段落级上下文处理能力。

- 识别错误引起的链式错误:OCR或语音识别出错会“把翻译拉偏”,不是翻译模型本身的问题,但最终用户感受就是“翻译不准”。

实用建议:不同场景下如何选用或配合使用

- 旅行与吃喝玩乐:若需要低延迟、拍照识别菜单、常用短句快速对话,优先考虑易翻译这种本地化优化、界面友好的工具;同时装两款,遇到歧义时交叉验证。

- 日常学习/阅读:谷歌翻译在理解长段和提供多种译法方面仍占优势,可以作为第一参考,再用词典或专业资料核对。

- 专业文档(医疗、法律、技术):不建议完全依赖任意一款在线工具;推荐使用专业译员或先用机器翻译打底,再做人工后编辑(MTPE)。如果必须自动化,选择支持术语管理与可定制化训练的产品。

- 隐私敏感场景:优先选择提供离线翻译或本地部署选项的工具,并确认服务商的隐私条款与数据保留策略。

- 低资源语言或方言:谷歌在多语言泛化上优势明显,但对某些方言或罕见语种,地方化产品若有专门采集语料可能更合用。

提升翻译质量的实用技巧(快速可用)

- 短句优先:把复杂从句拆成短句,减少歧义。

- 提供上下文:输入前后句或主题提示(如果工具支持上下文记忆)。

- 固定术语表:对专业文档上传术语表或使用可自定义词典。

- 多工具比对:遇到歧义时把译文放到另外一个翻译器对比,快速判断哪种更自然。

- 人工校对:对重要内容总要有人校对,尤其法律与医疗文本。

评估指标小贴士(方便自己做对比)

如果你愿意做些量化工作,以下组合实用且易上手:

- BLEU:快速自动化指标,适合基准对比,但对流畅度弱感知。

- chrF:对字符级别差异敏感,适合中英之间的细粒度评估。

- COMET或人类评估:更接近真实可用性,推荐在自动指标之外加入人工评分。

参考与背景文献(可以进一步阅读)

- Papineni et al., “BLEU: a Method for Automatic Evaluation of Machine Translation”, 2002.

- WMT shared tasks and reports (年度机器翻译评测竞赛) — 比较不同系统在多语言、多领域上的表现。

- COMET: A Neural Framework for MT Evaluation — 近年来较受推荐的自动评估方法之一。

- Google Neural Machine Translation (GNMT) 相关论文与技术博客,了解大型端到端系统的设计思路。

从用户角度怎么选择:一个简单的判断流程

如果你不想做大规模测试,下面这个小流程几乎能在30分钟内帮你决定:

- 列出3种你最常翻译的文本类型(例如:聊天短句、技术文档、菜单照片)。

- 各挑选20条真实样本,分别用易翻译与谷歌翻译进行翻译。

- 用5分制快速打分(准确度、流畅度、可用性)并记录倾向性错误。

- 如果两个工具在你最关键的场景差距不大,优先选用体验更好、响应更快、隐私策略合适的那个。

说到这里,你可能会想:那直接两者都装上手机不就完了吗?确实,很多人的做法就是“先试、再选”,在真实对话中交替使用两款工具,遇到不确定的译法再让朋友或在线词典帮忙确认。机器翻译已经很方便了,但它们不是完美的语言替身,遇到关键文档或法律、医学类内容,手工核对仍然不可或缺。

最后补一句,技术在变,模型在更新,今天的“更准”未必是明天的结果。你如果愿意花点时间做简单对比,通常能找到最适合自己场景的那一款;如果懒得比对,两款工具并行使用、把机器翻译当作第一道筛查,再用人工去把关,几乎能满足绝大部分需求。就像平常选菜,既看颜值也看口味,翻译工具也是多对比,多尝试。