易翻译的翻译质量评估应结合自动评测指标、人工主观评价与任务导向测试。自动指标(如BLEU、chrF)可快速量化;人工评估关注流利度与信息完整性;任务测试检验真实场景表现。还要考虑语音识别、OCR、延迟与语言覆盖等多维度,建立标准化流程、标注指南与统计显著性检验,持续迭代。用户反馈也很重要,实时监控与AB测。

先把事情讲清楚:为啥要这样评估?

如果把翻译质量看成一道菜,自动指标是秤和温度计,人工评估是试吃的人,任务测试是看这道菜端到客户桌上能不能吃完。只靠一种方法不够:机器分数高不代表人吃得下,人与人主观差异大,真实场景可能还有网络、语音识别、拍照识别等“厨房事故”。所以完整的评估必须是多维度、分层次的。

评估的目标是什么?

- 量化稳定性:用自动指标快速追踪模型变动。

- 体验可信性:用人工评估保证输出对用户有意义且可读。

- 场景适配:根据旅行、商务、学习等不同场景检验实际可用性。

- 系统级表现:考虑ASR(语音识别)、OCR(拍照取词)、延迟等流水线因素。

怎么评估:从宏观到微观的流程

下面把评估拆成步骤,像搭积木一样,一步一步来。

1. 明确评估维度(先画地图)

- 自动评测:BLEU、chrF、METEOR、TER、BERTScore等,量化机器翻译和参考译文的相似度。

- 人工评估:流利度(Fluency)、完备性/忠实度(Adequacy)、可懂度(Comprehensibility)、风格与语域(Register)。

- 任务导向指标:任务成功率(Task Success Rate)、完成时间、用户满意度、错误恢复能力。

- 模块化指标:ASR的WER/CER、OCR的Precision/Recall/F1、延迟(Latency)、吞吐量(Throughput)。

- 覆盖与稳健性:支持语言数、方言、专有名词、行业术语、口语与俚语。

2. 准备测试集(数据就是实验的基石)

测试集要既代表常见使用场景,也包含难点。建议把数据分层:

- 核心集(Core):高频、代表性短句、日常对话。

- 领域集(Domain):商务合同、电商商品描述、旅游对话、技术文档等。

- 长句/复杂结构集(Complex):从句、长句、嵌套结构。

- 噪声集(Noisy):ASR误识别常见错误、OCR光照/角度干扰、方言或拼写变体。

- 极端集(Edge cases):多义词、文化特有表达、典故和俚语。

3. 自动指标:快速但要懂它的局限

工具箱里的规则秤。自动指标便于大规模对比、回归测试和模型选择,但不能替代人工判断。

- BLEU:衡量n-gram重合,适合离线比对,但对词序和同义表达敏感度低。

- chrF:基于字符的F-score,对语言形态变化更鲁棒,尤其对形态丰富语言有优势。

- METEOR:涵盖词形变化与同义词匹配,适合更语义导向的评估。

- TER(Translation Edit Rate):衡量编辑距离,越低越好,反映修改成本。

- BERTScore:用语义向量比对,能发现语义相似但表面不同的翻译。

小提醒:把多个指标一起看,构成“综合分”。

4. 人工评估:怎么去标注才可靠?

人工评估要可重复、可量化。建议做法:

- 制定明确标注指南:对“完备性”“流利度”“术语保留”等给出示例和边界。

- 采用等级评分(比如1-5)或对比式评估(A/B Blind Test)。

- 做标注员培训和预实验(calibration),直到标注一致性达到要求。

- 计算一致性指标:Cohen’s kappa、Krippendorff’s alpha,目标kappa≥0.6为可接受,≥0.75较好。

- 标注量与抽样:对常见场景多抽样,罕见和极端案例要重点覆盖但样本可少。

5. 任务导向测试:真实场景的“味道”

比如在旅行模式下,用户用语音对话询问车站在哪儿,系统需要理解并返回准确、简洁的回答。任务指标包括:

- 任务成功率(用户是否完成目标)

- 时间成本(含等待和重试)

- 用户叙述的理解率(是否需多次澄清)

- 情绪和满意度(可用NPS或Likert量表测量)

语音与拍照场景的特殊考量

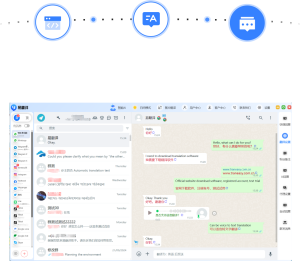

易翻译集成了语音实时互译与拍照取词,评估时必须把这些模块作为整体来测试。

ASR性能(语音识别)

- WER(Word Error Rate):主指标,越低越好。

- CER(Character Error Rate):对中文等字符语言更实用。

- 噪声、口音、语速、重叠语音会影响ASR,从而连带影响MT(机器翻译)。需要做组合测试(ASR→MT管线表现)。

OCR性能(拍照取词)

- 指标:Precision、Recall、F1,用于提取词或短句的准确性。

- 要测试不同光照、字体、倾斜角度、复杂背景,以及中英混排的识别能力。

- 对术语、数字、货币和专有名词尤为敏感,需专项测试。

端到端性能(ASR/OCR→MT→TTS等)

测量从用户说话/拍照到最终译文呈现的整体延迟和正确率,有时即便中间模块有误,最终结果仍可接受(例如歧义被上下文纠正)。所以端到端任务成功率是关键指标。

统计与显著性:别被随机波动欺骗

比较两个模型或两次迭代时要用统计检验,常用的方法有Bootstrap置信区间、paired bootstrap、Wilcoxon signed-rank或t检验(视数据分布)。关键点:

- 样本量要足够:自动指标可用大样本,人工评估样本通常受限,建议至少几百条。

- 报置信区间而非单点估计。

- 在报告中同时给出效果大小(effect size),不要只报p值。

如何组织一次可复现的评估实验(实操步骤)

- 定义目标:例如“提升英中口语互译在旅行场景的任务成功率到90%”。

- 准备数据:分层抽样,制作参考译文,列出场景标签。

- 选定指标:自动(BLEU/chrF/BERTScore)、人工(1-5流利度/完备度)、任务(成功率、时间)。

- 标注指南与培训:列举示例、边界情况、纠纷处理规则。

- 执行评测:跑自动指标、组织人工标注、完成任务测试。

- 分析与可视化:错误分类、热图、分场景对比。

- 统计检验与置信区间:判断差异是否显著。

- 反馈到研发:根据错误类型优先修复ASR、词典、或MT模型。

- 持续监控:在线上做抽样监测、A/B测试与用户反馈收集。

一个简单的评价矩阵示例

| 维度 | 指标 | 目标/阈值 |

| 自动评测 | BLEU / chrF / BERTScore | BLEU↑/chrF↑(相对基线提升) |

| 人工评估 | 流利度 1-5 / 完备度 1-5 | 平均≥4, Cohen’s kappa≥0.6 |

| ASR | WER / CER | WER ≤10%(安静环境) |

| OCR | Precision / Recall / F1 | F1 ≥0.9(清晰文本) |

| 端到端 | 任务成功率、延迟 | 任务成功率≥90%,延迟≤1s(实时对话) |

常见问题与解决策略

1. 自动指标与人工感受不一致怎么办?

这是常见的。做法是增加BERTScore或人工对比评估,找出差异来源:是同义替换、结构性调整,还是词序问题。针对具体问题调整模型或后处理规则(例如术语表约束)。

2. 标注员意见分歧很大?

回到标注指南和培训环节,增加示例并进行仲裁流程。必要时采用混合评分法:平均分+仲裁。

3. 端到端延迟超标?

先剖析时间来源:ASR延迟、网络传输、模型推理。可考虑本地化ASR、轻量化模型、流式翻译(streaming MT)或中间层缓冲策略。

把评估结果变成可执行的改进计划

评估不是终点,关键是把洞察转化为任务。常见路径:

- 高WER导致翻译错误 → 优先优化ASR或增加口音样本训练。

- 术语错误频发 → 建立行业术语库和术语优先级策略。

- 延迟影响体验 → 引入流式翻译和模型压缩。

- OCR对光照敏感 → 数据增强与图像预处理。

示例:一个简短的评分演示(手把手)

设句子:中文原文“请问地铁站在哪里?”参考英译“Excuse me, where is the subway station?”。机器译文A:“Where is the metro station?” 机器译文B:“Where can I find the subway?”

- 自动指标:A与参考高n-gram重合,BLEU较高;B与参考同义但词序不同,BLEU略低,BERTScore显示A、B语义接近。

- 人工评估:

- 流利度:A 5/5,B 5/5。

- 完备度:A 5/5(精准),B 4/5(含义相同但场景暗示稍弱)。

- 结论:结合BERTScore与人工,A略优;若目标是口语自然,B也可接受。

持续监控与线上指标

把评估体系迁移到线上要注意:

- 采样机制(按地区、设备、场景分层抽样)。

- 埋点定制(错误率、重试率、用户中断)。

- 用户反馈收集与快速回路(report→label→retrain)。

一些小技巧(实践中的那些经验)

- 对专有名词和地名做词典优先匹配,减少误译。

- 为低资源语言使用chrF与人工结合的策略。

- 做“对话记忆”测试,看连续句子的一致性与指代跟踪。

- 在A/B测试中同时监控移动端流量与错误分布,避免偏样本。

说到这里,其实评估一款像易翻译这样的产品就是要把“量化”和“体验”同时放在桌子上,别急着只看一个分数……就先写到这里,后面再想想具体实验设计和标注样例。